Nowy system opracowany w laboratoriach Google wydaje się być jednym z ciekawszych do rozpoznawania języka migowego. Jeśli faktycznie zapewni wysoką sprawność, to może w przyszłości wpłynąć na życie wielu osób.

Jedną z głównych zalet dostępnej technologii jest znaczący wpływ na sposób komunikacji. Dziś wystarczy smartfon, aby móc rozmawiać nie tylko ze znajomymi z miasta, ale również z osobą na innym kontynencie. Mamy już komunikatory internetowe, serwisy społecznościowe i rozmowy wideo w wysokiej jakości. Największe firmy IT pracują natomiast nad coraz lepszymi inteligentnymi systemami tłumaczenia, które niebawem powinny znieść barierę językową, dostarczając idealnie przetłumaczony tekst w czasie rzeczywistym podczas rozmowy głosowej.

W planach jest nie tylko zniesienie barier językowych, ale także ułatwienie życia osobom z poważnymi wadami wzroku i słuchu. Google przedstawił właśnie autorski system wykrywania gestów dłoni i palców. Jak już wspomniałem we wstępie, może on w przyszłości znaleźć zastosowanie w rozpoznawaniu języka migowego.

Nowa technika wykorzystuje m.in. rosnącą wydajność systemów uczenia maszynowego. Pozwala to na stworzenie dokładnej mapy dłoni i wszystkich palców, przy użyciu kamery wbudowanej w smartfon. Nie jest więc potrzebny żaden specjalistyczny sprzęt czy komputer o dużej mocy obliczeniowej. To naprawdę ważne, bowiem dzięki temu technologia może dotrzeć do dużej grupy osób.

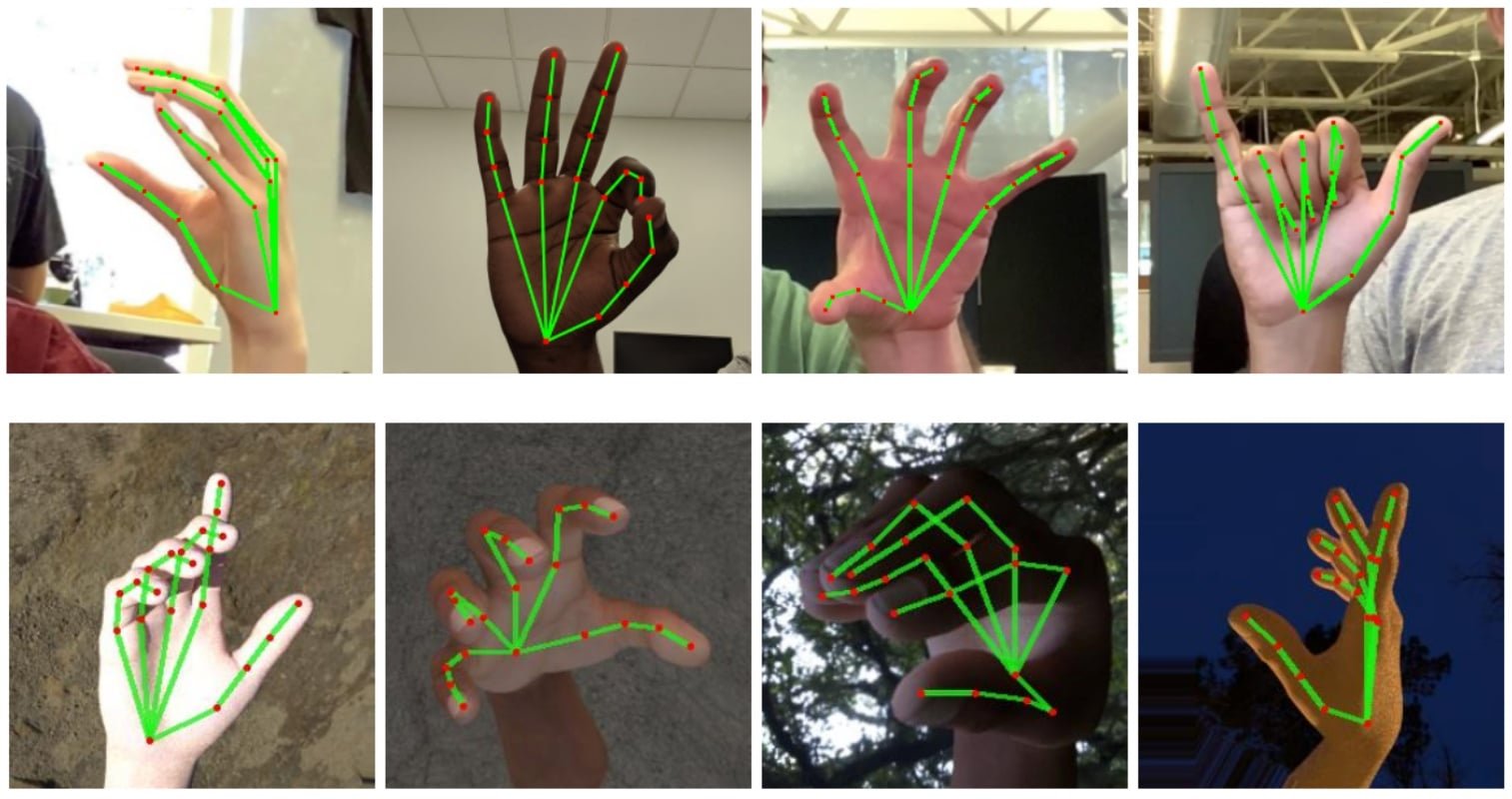

System Google potrafi rozpoznać do kilku dłoni w jednym kadrze. W przypadku każdej tworzona jest jej mapa, a także wykrywane są palce. Ruchy dłoni są śledzone w czasie rzeczywistym, a następnie po wykryciu pewnych wzorców, system stara się ustalić pokazany gest.

Co ciekawe, celem badaczy Google było ograniczenie informacji zbieranych z dłoni. Wyszli oni z założenia, że mniej danych to sprawniejsza realizacja zadań przez oprogramowanie. Porzucony został więc pomysł, aby system wykrywał pozycję i rozmiar dłoni – rozpoznawana jest jej sama obecność w kadrze.

Na dłoń nakładanych jest 21 punktów, których położenie jest cały czas śledzone. Punkty zostały umieszczone w odpowiednich miejscach, aby każde zgięcie palca dało się zauważyć. Aby to osiągnąć, algorytm musiał zostać „nakarmiony” 30 tys. różnych zdjęć dłoni, które pokryto wspomnianymi 21 punktami.

Nie jest to jeszcze rozwiązanie, które faktycznie może zainteresować osoby posługujące się językiem migowym. Obecnie jest w fazie wczesnych testów i przed badaczami jeszcze sporo pracy, aby usprawnić oprogramowanie, a także nauczyć algorytmy większej liczby gestów. Aktualna lista wykrywanych gestów jest bowiem dość uboga.

Należy mieć na uwadze, że na finalny efekt prac będziemy musieli jeszcze trochę poczekać. Rozpoznawanie ruchów dłoni jest naprawdę trudne – ruch często wykonywany jest z różną szybkością, a także poszczególne palce mogą być zasłaniane. Całość jest jeszcze bardziej złożona, gdy gesty wymagają użycia dwóch dłoni.

Warto dodać, że badacze zdecydowali się udostępnić wyniki swojej pracy, aby każdy zainteresowany mógł dalej rozwijać ich ambitny projekt.

źródło: TechCrunch, Google