WeTransfer to jedna z najpopularniejszych usług chmurowych do przechowywania i udostępniania plików. Jej nowy regulamin wywołał jednak falę negatywnych komentarzy i pomimo natychmiastowej reakcji, część użytkowników może się bezpowrotnie od niej odwrócić. Nie ma w tym niczego dziwnego, bo cała sprawa toczy się o prywatność i ewentualne wykorzystywanie osobistych plików do trenowania AI.

Nowy regulamin WeTransfer i szkolenie AI na plikach użytkowników. O co chodzi?

Usługa WeTransfer opublikowała nowy regulamin, a w nim można było przeczytać, że użytkownik daje operatorowi prawo do przetwarzania, modyfikowania czy dystrybuowania treści na potrzeby tworzenia, komercjalizowania i udoskonalania technologii i modeli uczenia maszynowego. Taki zapis przez wiele osób został zinterpretowany jako prawo serwisu do wykorzystywania prywatnych plików do szkolenia sztucznej inteligencji.

W sieci zaroiło się od negatywnych komentarzy, zapowiedzi rezygnacji z korzystania z usługi i bezpośrednio wyrażanego żalu. Zatroskani o prywatność wydali się przede wszystkim artyści chroniący swoich praw intelektualnych (m.in. ilustratorka Sarah McIntyre, aktorka Stephanie Kerbis, aktor Matt Lieb czy muzyk Gav (Miracle Of Sound)).

How is this acceptable, @WeTransfer? You’re not a free service, I *pay* you to shift my big artwork files.

— Sarah McIntyre (@jabberworks) July 15, 2025

I DON’T pay you to have the right to use them to train AI or print, sell and distribute my artwork and set yourself up as a commercial rival to me, using my own work.😡 pic.twitter.com/OHPIjRGGOM

WeTransfer komentuje: to pomyłka

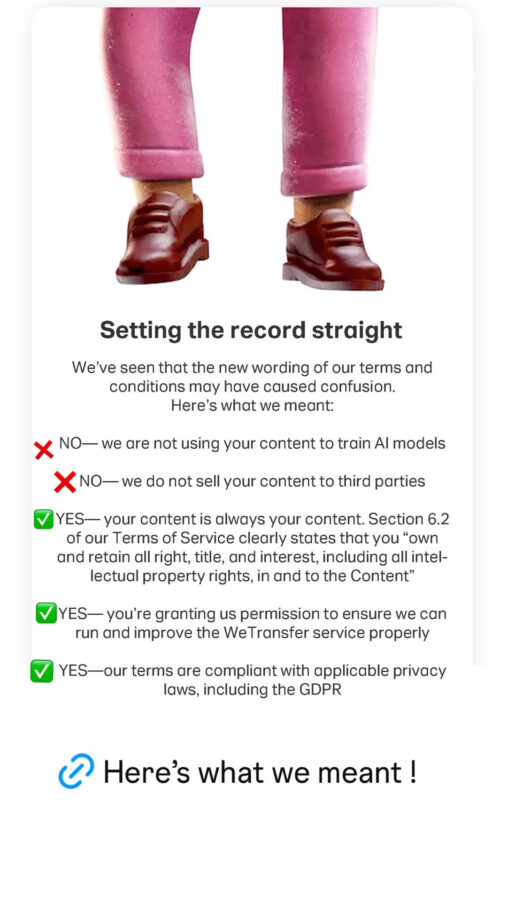

Firma WeTransfer odniosła się do sprawy. Głosem rzeczniczki prasowej wyraźnie zaprzeczyła medialnym rewelacjom i podkreśliła: nie wykorzystujemy sztucznej inteligencji do przetwarzania treści udostępnianych w naszej usłudze ani nie sprzedajmy danych żadnym zewnętrznym podmiotom.

Od razu też wprowadzona została nowa wersja regulaminu. Postawiono w niej na prostszy język, aby uniknąć nieporozumień. Równocześnie wyjaśniono, że klauzula została pierwotnie dodana po to, żeby umożliwić wykorzystanie sztucznej inteligencji do moderacji treści i identyfikacji szkodliwych treści.

W nowej wersji czytamy, że – po prostu – jako użytkownik udzielasz bezpłatnej licencji na korzystanie z twoich treści w celu obsługi, rozwoju i ulepszania usługi, zgodnie z naszą polityką prywatności i polityką dotyczącą ciasteczek.

Rozjaśnienie czy zupełna zmiana?

Reakcja na tę zmianę wcale jednak nie jest jednogłośnie pozytywna. Pojawiają się zarzuty, że poprzednia wersja nie była niejasna, lecz najzwyczajniej w świecie była inna. Do tego także odnieśli się przedstawiciele firmy WeTransfer, tłumacząc wszystko ludzkim błędem.

W efekcie na oficjalnym blogu WeTransfer pojawił się obszerniejszy wpis, wyjaśniający, co tak naprawdę zmienia się w nowym regulaminie usługi. Czytamy w nim, że twoje treści zawsze pozostają twoje [i] zachowujesz do nich wszelkie wszelkie prawa, ale też, że udzielasz nam pozwolenia na prawidłowe zarządzanie i ulepszanie usługi w zgodzie z obowiązującymi przepisami o ochronie prywatności i równocześnie, że twoje treści nie są wykorzystywane do trenowania modeli AI ani sprzedawane zewnętrznym podmiotom.

A co do samego uczenia maszynowego, które przecież w poprzedniej wersji regulaminu pojawiło się wprost, we wpisie odnajdujemy informację, że sprawdzaliśmy możliwość wykorzystania AI do usprawnienia moderacji treści, [ale] taka funkcja nie została jeszcze opracowana, ani nie jest wykorzystywana w praktyce. […] Aby uniknąć nieporozumień, usunęliśmy tę wzmiankę.

Czy to zakończy temat?

Cóż, możliwe scenariusze są różne. Bez wątpienia jednak nie może dziwić reakcja użytkowników, szczególnie tych powiązanych ze światkiem artystycznym. Nie od wczoraj mówi się o kontrowersjach związanych z generowaniem treści przez sztuczną inteligencję, nierzadko będących plagiatami i zagrażających ludzkim artystom.

I choć tym razem interpretacja okazała się przesadzona (a przynajmniej na to wskazują komentarze przedstawicieli usługi WeTransfer), to wyraźnie widać brak zaufania wobec firm technologicznych, a zarazem odpowiedzialność wyrażaną poprzez brak zgody użytkowników na to, by ich dane służyły do szkolenia sztucznej inteligencji. Tego typu reakcja wydaje się pozytywnym aspektem w całej tej sprawie.

Niemniej raz jeszcze przypomina nam to, że warto się trzy razy zastanowić, zanim cokolwiek wrzuci się do sieci – nawet, jeśli nie robi się tego publicznie. Dokonując tego, tracimy przynajmniej część kontroli nad plikami i nawet jeśli początkowo wszystko jest w porządku, to w każdej chwili może się… zmienić regulamin.