Jeśli masz obsesję na temat „Westworld” albo wizja z „Ex Machina” wydaje ci się niebezpiecznie realna, to może powoli przygotowujesz się już do zbliżającej się zagłady ludzkości. Wiesz – świt sztucznej inteligencji. Facebook ma dla nas radę: Ludzie, weźcie głęboki oddech.

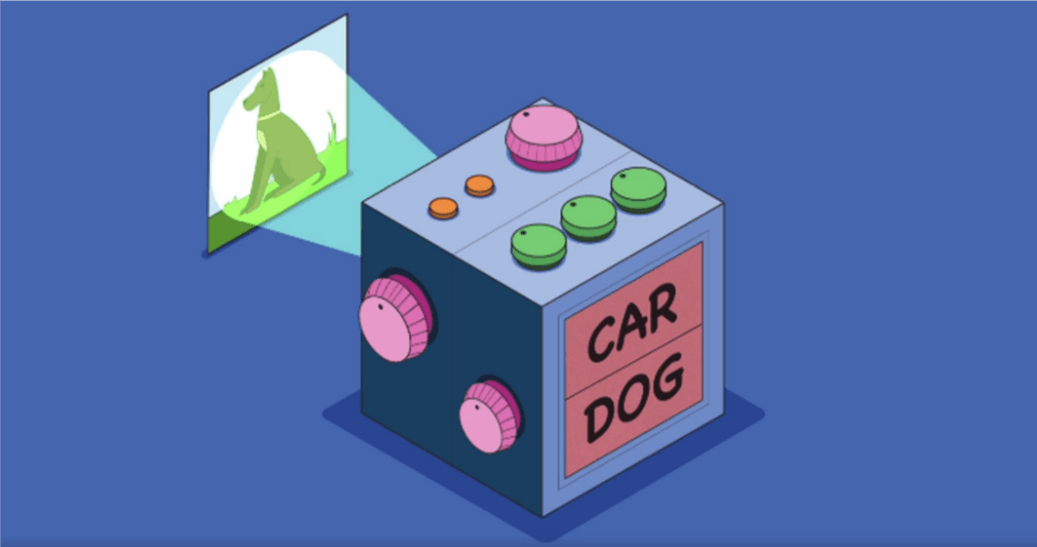

Gigant społecznościowy w czwartek rozpoczął kampanię mającą na celu demistyfikację Sztucznej Inteligencji przez edukowanie ludzi, jak ta technologia działa. W kilku krótkich filmach, Facebook wyjaśnia procesy, które stoją za rozpoznawaniem poszczególnych elementów zdjęć, mówi kto prowadzi samoprowadzące się pojazdy oraz jak tłumaczy się miliony linii tekstu w Google Translator. Wszystko ma pomóc w rozwianiu obaw, jakoby SI miało poprowadzić wymierzony przeciwko gatunkowi ludzkiemu bunt maszyn.

Sztuczna Inteligencja już działa. Jest elementem wielu usług internetowych, których używasz na co dzień. Na Facebooku i Instagramie, AI pomaga sortować i ustalać priorytety tego, co masz zobaczyć na swoim feedzie jako pierwsze. Bierze pod uwagę twoje kliki „Lubię to” oraz serduszka, które porozdawałeś dziesiątkom zdjęć, i wypycha na wierzch te treści, które mogą cię najbardziej zainteresować. W Dolinie Krzemowej Google używa SI niemal do wszystkiego: od wyszukiwarki konkretnych fraz w sieci do samojezdnych samochodów bez kierowcy. Prezes tego technologicznego giganta, Sundar Pichai powiedział, że priorytety firmy zaczynają się mocno przesuwać. I nie jest to już „mobile-first”, przyznający pierwszeństwo smartfonom i urządzeniom przenośnym, a „AI-first”, co oznacza, że Google coraz większą wagę będzie poświęcać technologiom Sztucznej Inteligencji.

Szef Facebooka, Mark Zuckerberg szacuje, że jedna czwarta inżynierów jego firmy i ponad 40 zespołów już teraz pracuje na platformach wspieranych przez AI. Jeden z tych zespołów, zajmujący się praktycznie tylko i wyłącznie rozwiązaniami SI (Facebook AI Research group, w skrócie: FAIR), zatrudnia ponad 75 inżynierów i naukowców rozproszonych po całym świecie. Kolejna specjalistyczna ekipa, AML (Applied Machine Learning), pracująca nad ulepszonymi technikami uczenia maszynowego, ma około 140 członków.

Gigantyczne ilości gotówki oraz masa czasu i energii pompowane w Sztuczną Inteligencję niespecjalnie pomogły tej dziedzinie w pozbyciu się krytyki, jaką często jest poddawana. Z lubością nagłaśnia się negatywne opinie, pokroju „proroctw” Stephena Hawkinga, że AI może oznaczać koniec ludzkości. W tym samym czasie prezes Tesli, Elon Musk wraz z innymi podmiotami z Doliny Krzemowej uruchamia wspólnymi siłami firmę badawczą non-profit, o nazwie OpenAI. Jej celem jest rozwijanie Sztucznej Inteligencji w taki sposób, by mógł skorzystać na niej cały nasz gatunek, a nie tylko ta mała jego część, którą szczęśliwie stać na najnowsze gadżety technologiczne. Czy zatem Musk chce nas wszystkich wykończyć?

SI i uczenie maszynowe to rodzaj technologii, która pozwala komputerom na podejmowanie działań nie przewidzianych wcześniej przez ich twórców. Zachowanie tych programów nie zostało wcześniej oskryptowane, w ich kodzie nie zawarto fragmentów, które miałyby uruchomić się dopiero po jakimś czasie, żeby tylko sprawić wrażenie inteligentnych. One po prostu porównują ze sobą różne dane, gromadzą o nich swego rodzaju wiedzę i wykorzystują ją do analizy kolejnych danych. Kwestia roli, jaką uczenie maszynowe odegrało podczas ostatnich wyborów prezydenckich w USA jest w dalszym ciągu przedmiotem dyskusji. Jasne jest, że wygrywa ten, to zawładnie szeroko pojętą informacją: zasięgiem jej rozpowszechniania i oddźwiękiem, jaki wywołuje w odbiorcach. A co, jeśli o jej zasięgu nie decyduje człowiek, tylko… algorytm?

Jak Sztuczna Inteligencja już wpływa na decyzje ludzi

No nie bezpośrednio. Żaden elektroniczny głos nie mówi nam, co mamy zrobić, gdzie pójść, i co zjeść na kolację. Ale jesteśmy podatni na sugestie. Algorytmy facebookowego strumienia wydarzeń są częściowo zasilane przez uczenie maszynowe i to one decydują o tym, co zobaczymy, a czego nie zobaczymy na naszym newsfeedzie. Krytycy prezydenta-elekta, Donalda Trumpa, są zdania, że fałszywe informacje, które pojawiały się w strumieniach milionów użytkowników Facebooka odegrały ważną rolę w zwycięstwie tego kandydata.

Dzięki temu, że nasz feed bazuje na tym, co oglądamy i jakim treściom klikamy „Lubię to”, staje się on bardzo ograniczonym źródłem informacji. Algorytmy analizujące nasze preferencje są bardziej skłonne pokazywać nam treści podobne do poprzednich, co prowadzi do efektu tzw. „bańki filtrów” (lub „bańki informacyjnej”) – użytkownicy zamykani są w wirtualnej przestrzeni, w której pojawiają się treści zgodne z ich sposobem korzystania z platformy społecznościowej. Im bardziej zaangażowany użytkownik, tym bardziej ciasna może stawać się informacyjna bańka, i tym trudniej przedostać się do niej innym wiadomościom, stojącym w opozycji do polubień. W ten sposób użytkownik otrzymuje znacznie mniej informacji, które mogłyby pomóc mu obiektywniej spojrzeć na daną sprawę.

Yann LeCun, prowadzący FAIR jest zdania, że AI może zmniejszyć problem bańki filtrów, ale pozostaje jeszcze pytanie, jak to wdrożyć od Facebooka. „My prawdopodobnie dysponujemy odpowiednią technologią” – powiedział w zeszłym miesiącu LeCun. „Tylko, że to nie technologia jest tu problemem. Chodzi o to, żeby do 'działało’ również po stronie produktowej i funkcjonowania serwisu” – dodał.

Facebook zaprzecza, jakoby serwis odegrał decydującą rolę w wyborach prezydenckich w USA, i twierdzi, że firma nie zbudowała w tym celu żadnych narzędzi. Prezes firmy, Mark Zuckerberg, powiedział na konferencji, która odbyła się wkrótce po wyborach, że Facebook nadal będzie pokazywać użytkownikom informacje, z którymi mogą się nie zgadzać. „To nie jest tak, że różnorodnych informacji po prostu nie ma. Są. Tylko niektóre z nich po prostu nie zdołały zaangażować ludzi w większym zakresie” – tłumaczy Zuckerberg.

W zeszłym miesiącu Mark ogłosił plan dotyczący zwalczania nieprawdziwych, lecz szybko zyskujących popularność wiadomości. Ma on obejmować opracowanie lepszych „systemów technicznych”, których zadaniem byłoby oznaczanie takich treści, zanim zyskałyby popularność. Jednocześnie Facebook stara się o to, by Sztuczna Inteligencja wspierała więcej produktów i usług, a nie tylko samą platformę społecznościową.

Joaquin Candela, który prowadzi zespół AML, powiedział, że Instagram, będący własnością Facebooka, już od początku tego roku korzysta z nowych algorytmów szeregowania treści. Dzięki nim zastąpiono odwróconą chronologię wyświetlania zdjęć i filmów, nowym sposobem ich prezentacji – żywcem przejętym z AI, stosowanej już podczas doboru priorytetów w Facebooku.

Filmy, które pojawiły się niedawno w sieci z inicjatywy Facebooka, starają się w prosty sposób wyjaśnić, jak działają inteligentne algorytmy, uczenie maszynowe i to, co nazywamy Sztuczną Inteligencją.

„To nie jest magia” – powiedział w zeszłym miesiącu Candela. Zaraz potem LeCun dodał jednak: „Ale staramy się, żeby to tak wyglądało”.