Wyszukiwarki to nasze okno na świat. Świat, w którym istnieje tylko to, co w nich znajdziemy. Dlatego majstrowanie w wynikach wyszukiwania to formatowanie świata.

Dwa tygodnie temu w felietonie o internetowym hurraoptymizmie wspomniałem o nowomowie – pomyśle pięknie opisanym w Roku 1984 G. Orwella. Pomyśle zakładającym, iż wpływać na ludzi – a więc na rzeczywistość przez nich postrzeganą – można właśnie za pomocą języka, zmieniając znaczenie słów a inne po prostu eliminując. W sytuacji klasycznej, rodem ze wspomnianej książki, usunięcie słowa zły i zastąpienie go bezdobrym to nie tylko prosta podmiana (jak choćby w modach na słowa, gdy w latach 90. mówiło się, że coś jest fajne, a po roku 2000 zastąpiło je cool). Zły a bezdobry to dwa różne obszary znaczeniowe. Coś złe jest czymś szkodliwym, czymś obcym, czymś, co należy zwalczać. Bezdobre to pozbawione dobra, a więc nie złe, a raczej upośledzone w kwestii wartości. Czyli takie do poprawki, do resocjalizacji.

Daleko ważniejsze jednak, że świat, z którego zniknie słowo zły, będzie trochę innym światem, niż ten, który znamy.

Zejdźmy z filozofii i wypracowań szkolnych na ziemię technologii. Już od dawna wszyscy mamy styczność ze światem, w którym słowa znikają. Jest nim internet. A przede wszystkim internet Google (choć nie tylko, takie Apple też mocno się zasłużyło w cenzurowaniu internetu, ale akurat w tym tekście to molochowi z Mountain View się oberwie). Bo to Google popełniło serwis What do you love? w którym po wpisaniu w pole wyszukiwania słowa shit…

… otrzymujemy w wyniku… kociaki. I sądząc po radości wpisanej w ideę serwisu – raczej śmieszne kociaki.

Wystarczy wyłączyć ułatwienie

Cała istota internetu to możliwość znalezienia w nim żądanej treści. Ułatwiają nam to wyszukiwarki internetowe, które indeksują miliardy stron internetowych i tryliardy znalezionych w nich słów, obrazków, obiektów multimedialnych. Człowiek sam z siebie nie byłby w stanie nie zgubić się pomiędzy nimi. Dlatego wyszukiwarki – tak, jak katalogi biblioteczne – pozwalają nam prędko dotrzeć w miejsce, gdzie składowana jest interesująca nas informacja.

Ale tak, jak w bibliotece najłatwiej utrudnić dostęp do jakiejś książki za pomocą usunięcia informacji o niej w katalogu, tak w internecie wystarczy po prostu wyłączyć wszystkie mechanizmy ułatwiające jej znalezienie. Rozwiązanie proste i eleganckie – cenzury nie ma, bo przecież książka / informacja nadal jest dostępna, tyle, że nie pomożemy jej znaleźć. Radź sobie sam. O.

W Google pierwszym i najprostszym dla użytkownika mechanizmem pomocy w wyszukiwaniu treści jest mechanizm autocomplete, pozwalający na zaproponowanie podobnych do wyszukiwanej fraz. Przecież możemy źle wpisać nazwisko aktora czy naukowca, możemy zrobić literówkę, albo po prostu pamiętać jedynie pierwszą sylabę z tytułu piosenki, która nas interesuje. Autocomplete to taki ułatwiacz – podpowiadacz, który wskazuje na to, czego podobnego ludzie już szukali w wyszukiwarce.

I aby utrudnić – dla wielu mniej obeznanych z siecią osób w sposób znaczący – znalezienie jakiejś frazy, wystarczy wyłączyć to ułatwienie.

Nie jest to nic nowego. Wszak gazety lub czasopisma różnego rodzaju przeprosiny i sprostowania publikują zazwyczaj na dalszych stronach, na dole, w okolicach reklam, drobnym drukiem. Dlatego, że są wizerunkowo dość słabe dla wydawnictwa. Gazecie nie zależy, by tekst trafił do czytelników, po prostu musi go opublikować, a im mniej osób to przeczyta, tym lepiej. Podobnie w aplikacjach mobilnych, wszelkie opcje dotyczące wyłączenia zbierania danych czy cofnięcia zgód są schowane dość głęboko i czasem mało logicznie rozrzucone w różnych submenu – po to, by po prostu utrudnić ich znalezienie.

Usunięcia różnych słów z mechanizmu podpowiedzi Google uzasadnia dobrem społecznym i prywatnym. Prym wśród blokowanych słów wiodą oczywiście frazy związane z erotyką i pornografią. Google nie jest tu jedyne, właściwie to Apple jest najbardziej purytańskie w tej antypornograficznej krucjacie…

[quote text_size=”small” author=”Steve Jobs”]

We do believe we have a moral responsibility to keep porn off the iPhone. Folks who want porn can buy and Android phone.

[/quote]

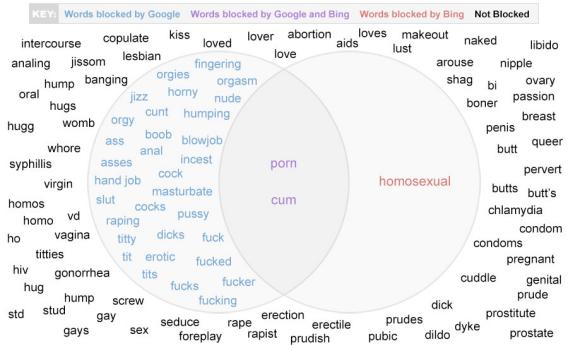

No cóż. Również i Google mnoży trudności fanom porno. Ale poza pornografią usuwane są również podpowiedzi do fraz, które mogą być wzbogacone o hejterskie rozwinięcia (które znamy np. z okrzyków stadionowych chuliganów). Dlatego w ułatwieniach podczas wpisywania nie ma pojęć drażliwych społecznie, a nawet nazwisk osób prywatnych, które nie życzą sobie być dostępnymi w wyszukiwarce. Nie znajdziemy w autocomplete fraz związanych ze słowami żyd, a słowa gej czy pedał są dość mocno filtrowane, by uniknąć prezentacji obraźliwych zestawień. Slate w 2013 roku zrobił fajną grafikę pokazującą słowa banowane nie tylko w angielskojęzycznym Google, ale też np. w Bingu.

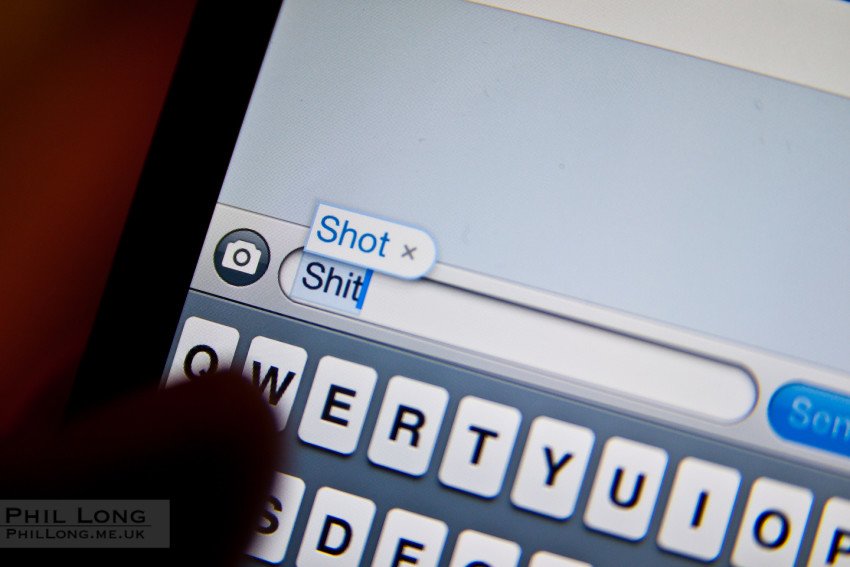

Co ciekawe, kontrola autocomplete nie dotyczy tylko wyszukiwarki. Użytkownicy urządzeń mobilnych używają przecież klawiatur ekranowych z opcją podpowiadania i autokorektą. Okazało się, że istnieją również słowa pod specjalnym nadzorem Google, których nie da się też prosto wpisać na smartfonie czy tablecie pisząc np. maila czy wiadomość na Facebooku. Dobreprogramy jakiś czas temu podały listę kilku zadziwiających słów banowanych w Androidzie w języku polskim. Jest ona zaskakująca! Są tam m. in. takie perełki, jak:

[quote text_size=”small” author=”dopreprogramy: Słownik Androida i słowa zakazane: Google ściga Apple w cenzorskich zapędach”]

uczennica, dzięcioł, kakao, lód, nonsens oraz nadczłowiek

[/quote]

O ile kakao czy nadczłowiek jestem w stanie jakoś objąć rozumem, to… No sorry, ale DZIĘCIOŁ??? Cóż dzięcioł uczynił Googlowi?!

Przypadek Pawła Kukiza

To samo, co dzięcioła w klawiaturze Androida, spotkało ostatnio jednego z kandydatów na prezydenta RP – Pawła Kukiza. Od 10 dni fraza składająca się z jego nazwiska lub imienia i nazwiska zniknęła z googlowskiego autocomplete. Temat wyłapał sam kandydat na prezydenta (a wcześniej muzyk), który zasygnalizował o tym na Facebooku. I rzeczywiście. Przy wpisywaniu “Paweł Kukiz” do pola wyszukiwarki jeszcze wczoraj nie pojawiało się nic związanego z kandydatem, natomiast pokazywały się podpowiedzi do osób dalece mniej znanych niż autor przeboju Całuj mnie. W związku z trwającą kampanią wyborczą oczywiście natychmiast odtrąbiono spisek polegający na próbie usunięcia kandydata z internetu, a na pewno utrudnieniu zainteresowanym znalezienia informacji o nim.

Smaczku sprawie dodaje, że zasadniczo to pierwszy przypadek „niewiadomego” i nie ogłoszonego przez jakiś konkurentów czy wrogów człowieka lub idei zniknięcia dość znaczącej postaci publicznej z podpowiedzi Google. Według firmy mechanizm jest w pełni zautomatyzowany. To nie jest tak, że pewnego dnia któryś z pracowników podjął decyzję, że Kukiz będzie frazą obraźliwą. O tym decyduje – jak zwykle u firmy z Mountain View – algorytm…:

[quote text_size=”small” author=”Autouzupełnianie w Google Support”]

Podpowiedzi autouzupełniania są generowane automatycznie przez algorytm, bez jakiegokolwiek udziału człowieka. Opierają się na pewnej liczbie obiektywnych czynników – np. informacji o tym, jak często użytkownicy wyszukiwali jakieś hasło w przeszłości. (…) Niekiedy zablokujemy zapytanie w jakimś języku, podczas gdy w innym nie budzi ono żadnych zastrzeżeń. Możemy na przykład przez przypadek zablokować wyrażenie, które zawiera tłumaczenie słowa uznawanego w innym języku za niecenzuralne.

[/quote]

W oparciu o te założenia pojawiły się w sieci artykuły (jak np. ten, który linkuję w źródłach) wyśmiewające w czambuł wietrzenie spisku i wskazujące, że nieobecność w systemie podpowiedzi to wyraz… braku zainteresowania kandydatem. Nie wdając się w ocenę wskażę jedynie to, na co wskazuje wielu internautów – iż Google pokazywał przecież w autocomplete innych, daleko mniej popularnych konkurentów P. Kukiza, a jego samego uparcie nie.

Od dziś rana fraza Paweł Kukiz jest ponownie dostępna w podpowiedziach w wyszukiwarce Google. Rzecznik prasowy firmy podał, iż był to… No cóż. Wiadomo. Błąd algorytmu.

To wszystko ma wpłynąć na rzeczywistość

Po co robi się takie rzeczy? Po jaką cholerę Google usuwa “żyda” i „porno” z podpowiedzi wyszukiwarki czy “dzięcioła” z podpowiedzi klawiatury? Dlaczego będąc dorosłym człowiekiem i chcąc pooglądać wideo z fiku miku trzeba pamiętać całą nazwę serwisu, bo wyszukiwarka nam nie podpowie?

Dla naszego dobra!

Abyśmy nie stykali się z agresją słowną. Aby przedstawiciele mniejszości narodowych, wyznaniowych czy seksualnych nie trafiali na mowę nienawiści podczas rutynowego korzystania z internetu. By z pierwszego kontaktu człowieka z internetem – z wyszukiwarki – wyeliminować złe słowa. Byśmy nie ujrzeli, w jaki sposób Polacy łączą słowo żyd z innymi, mniej lub bardziej obraźliwymi. By dzieci miały utrudniony dostęp do pornografii.

Czy to działa? Raczej słabo, choć osoby mniej obeznane z internetem może to zrazić do szukania danej frazy. Ale jeśli ktoś wchodzi w sieć dla pornografii to raczej nie przekona go porzucenia pomysłu to, że Google mu czegoś tam nie podpowie. Jeśli ktoś jest przepojony nienawiścią do jakiejś narodowości, to nie zmieni się dzięki temu, że nie ujrzy w wyszukiwarce Gogle tego, co mówi o nich z kolegami przy kakao.

Ale w ten sposób Google tworzy iluzoryczny świat, w którym nie ma zła. Próbuje formatować rzeczywistość na nową, w której pewne pojęcia, słowa, stany i rzeczy po protu… nie istnieją. Google nie ułatwi nam ich znalezienia w trosce o nas samych. Przykre? Oczywiście. Lecz przecież to w ogromnej trosce o nasze bezpieczeństwo Google każe nam zgodzić się z czymś, co może jest mniejdobre lub nawet minusdobre, dzięki temu nie będziemy widzieć tego, co jest złe!

Problem polega na tym, że ktoś lub coś musi dokonać oceny, co jest złe. Algorytm lub człowiek. I niewytłumaczalne przypadki dzięcioła czy Kukiza to pikuś przy tym, co bez zasłaniania się algorytmami dzieje się np. w Chinach. Tam cenzura nie obejmuje jedynie autocomplete. Z samych wyników wyszukiwania usuwa się tysiące tak zwyczajnych, neutralnych dla nas fraz, które przez rząd są uznawane za złe, np.

- Fire

- Torch

- Oil lamp

- Candle flame

- Blood

- Democracy

- Autonomous

- Today

- Tomorrow

- Yesterday

- Tiananmen

- Square

- Mourn

- That year

- That day

- Ceremony

- Little secretary

- Black shirt

- Black clothes

- Never forget

- Tank

- March

I choć wyszukiwania materiałów dotyczących tych fraz nie uda się oczywiście całkowicie zablokować, to można je znacznie utrudnić. Jeśli można usunąć z katalogu bibliotek wszelkie fiszki odnoszące się do dzieł o nich traktujących, to można też zablokować ich wyszukania w internecie. Nagle z internetu miliarda ludzi zniknęły słowa takie, jak ogień, demokracja, pochodnia, dziś, wczoraj, jutro lub Twitter. Aby się do nich dostać trzeba znacznie więcej zachodu. Trzeba poświęcić więcej czasu i posiadać więcej wiedzy. Wielu ludzi porzuci próby. Przestanie wyszukiwać te frazy. Być może przestanie się nimi interesować.

Być może zapomni o nich.

I tak się zmienia rzeczywistość. Na razie w internecie.

Na szczęście ludzie są uparci i złośliwi. Gdy zablokowano wyszukiwania haseł związanych z tragedią, która wydarzyła się w 1989 roku na Placu Tiananmen, Chińczycy zaczęli propagować w sieci przerobione słynne (i zabronione w Chinach) zdjęcie mężczyzny stojącego na drodze trzem czołgom. Czołgi zamieniono na cztery wielkie żółte kaczuszki. To zdjęcie jest ilustracją niniejszego felietonu.

Obrazek zrobił furorę i przy okazji przypomniał wielu o masakrze, jaką rząd chiński urządził swym obywatelom. Chińczycy zaczęli wyszukiwać w Google frazę BIG YELLOW DUCK, by zobaczyć tę przeróbkę na własne oczy.

W związku z pilną interwencją władz chińskich, Google musiał dodać do listy słów blokowanych w Chinach frazę wielka żółta kaczka.

I świat w Chinach zmienił się. Zubożał o mnóstwo kaczuszek.